Соц сеть Twitter анонсировала результаты открытого конкурса, призванного выявить систему предпочтений, отдаваемых искусственным умом при разработке превью изображений, которые загружаются юзерами. Компания отключила эту функцию в марте в ответ на жалобы в предвзятости ИИ в отношении чернокожих. Опосля этого она объявила конкурс на поиск бага, ведущего к схожим последствиям.

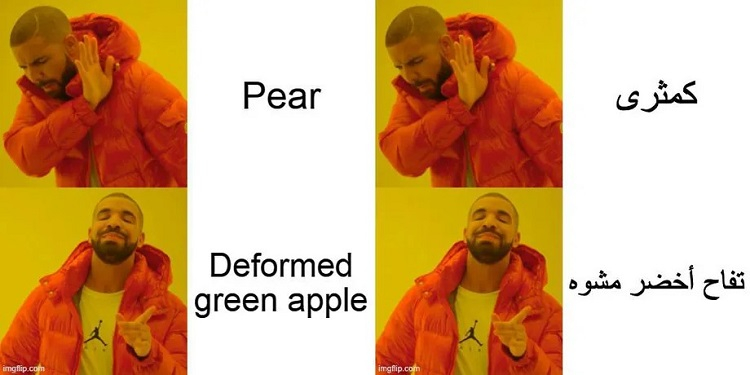

Конкурс подтвердил прежние «открытия». Фаворит узнал, что метод отдаёт предпочтение худеньким, юным, со светлым либо тёплым цветом кожи, с гладкой текстурой кожи и стереотипно женственными чертами лица. 2-ое и третье места заняли исследователи, доказавшие, что система тенденциозна в отношении людей с белоснежным либо сероватым цветом волос (дискриминация по возрасту) и, в конце концов, «предпочитает» британский язык арабскому на изображениях.

На презентации результатов на конференции DEF CON 29, глава команды Twitter, занимающейся исследованием этики, прозрачности и контроля за методами машинного обучения Румман Чоудхури (Rumman Chowdhury) высоко оценил работы участников за демонстрацию действия «тенденциозных» алгоритмов на настоящую жизнь. По его словам, речь идёт не только лишь о академическом интересе, да и том, какие схемы работают в самом обществе — создатели фильтров работают, исходя из внутренних убеждений и представлений о чудесном.

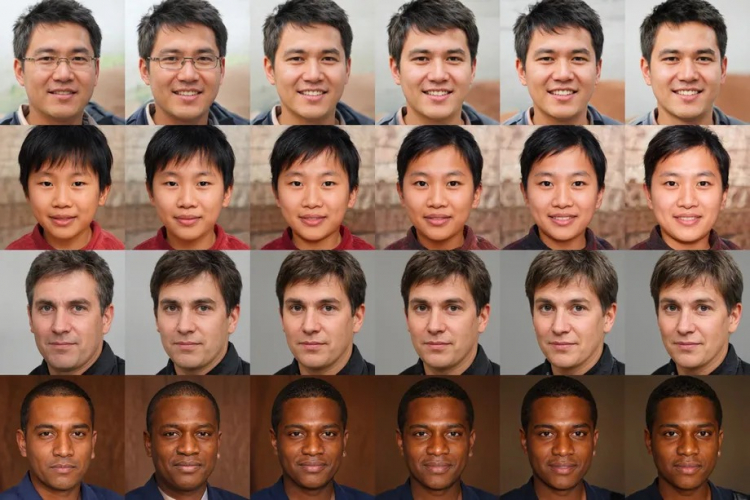

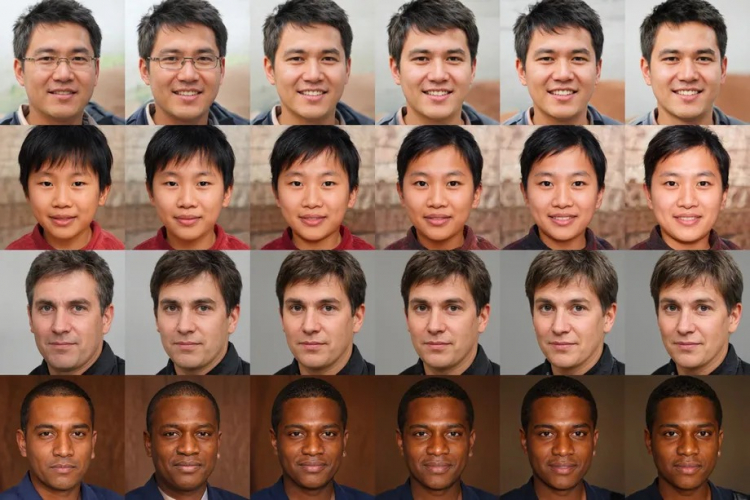

1-ый приз в размере 3500 баксов получил Богдан Кулинич (Bogdan Kulynych) из исследовательского института EPFL в Швейцарии. Он употреблял ИИ-программу StyleGAN2 для генерации огромного числа близких к реальности лиц, отличавшихся по цвету кожи, женственным либо маскулинным чертам лиц и полноте виртуальных участников. Опосля этого он «скармливал» изображения методу Twitter. В итоге Кулинич пришёл к заключению, что предрассудки алгоритмов усиливают предрассудки в обществе, практически «вырезая» из жизни тех, кто различается от «нормы» по весу, возрасту, цвету кожи.

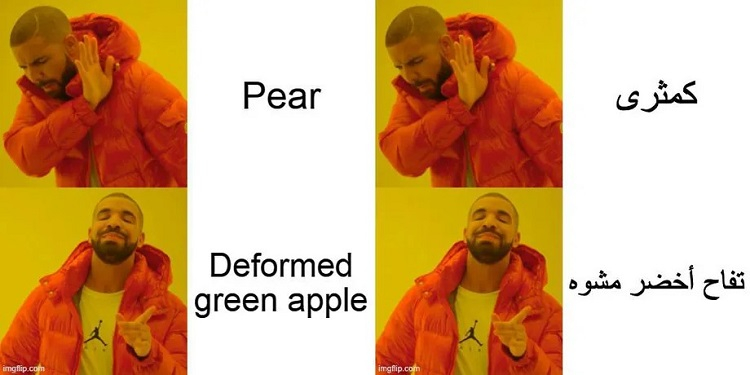

Подобные «предрассудки» наиболее всераспространены, чем можно пошевелить мозгами. Ещё один участник типо обосновал, что метод благосклоннее относится к наиболее светлым эмодзи. В конце концов, ещё одно увлекательное открытие — выяснилось, что метод Twitter быстрее обрежет часть изображения с арабским текстом, чем с английским.

Хотя результаты тестов обескураживают правозащитников, они также показывают, как общество может посодействовать технологическим компаниям. Открытость Twitter контрастирует с поведением неких техногигантов. Опосля того как команда Массачусетского технологического института нашла идентичные предрассудки в методах Amazon, в компании ответили, что подобные изыскания «вводят в заблуждение» и являются «неверными». Позднее Amazon пришлось отойти под давлением аргументов и поднявшейся в Сети шумихи.

По словам судьи конкурса Twitter Патрика Холла (Patrick Hall), подобные «предрассудки» есть во всех ИИ-системах, и компаниям нужно проактивно работать, чтоб выявлять их. «Если вы не ищете ваши баги, и охотники на баги не отыскивают ваши недоделки, тогда кто найдёт ваши ошибки? Поэтому что баги у вас есть буквально», — заявил он.